Introduction

La loi sur l’IA, la première sur ce sujet en Europe, vise à réglementer l’intelligence artificielle de manière à renforcer la confiance, la sécurité et l’innovation. Elle introduit un cadre axé sur différents niveaux de risques qui catégorise les systèmes d’IA et impose des obligations en fonction de leur impact potentiel sur la société.

Dans cet article, nous allons explorer ce qu’est la loi sur l’IA, ce que la phase 2 signifie pour votre entreprise à partir d’août 2025, et comment Eminence peut vous aider à transformer le respect des exigences réglementaires en un avantage stratégique.

Qu’est-ce que l’AI Act ?

L'AI Act, approuvé le 1er août 2024, est la première réglementation globale sur l'intelligence artificielle en Europe et dans le monde. L'objectif est d'encadrer le développement, la commercialisation et l'utilisation des systèmes d'intelligence artificielle sur le marché européen. Il vise à garantir le développement d'une intelligence artificielle éthique et centrée sur l'humain, tout en stimulant l'innovation en matière d'IA et en soutenant le bon fonctionnement du marché mondial.

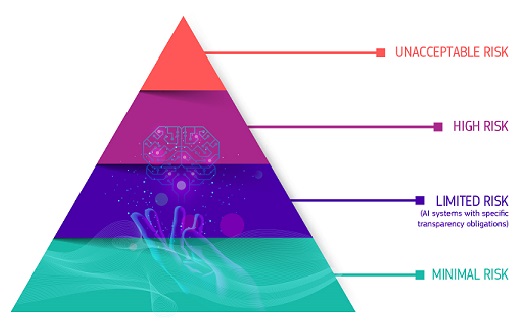

Elle applique un modèle fondé sur le risque, qui classe l'IA en quatre catégories : risk critique, risque élevé, risk limité, risk minimal et à usage général (GPAI).

- Risque inacceptable : tous les systèmes d'IA considérés comme une menace évidente pour la sécurité, le mode de vie et les droits des personnes sont purement et simplement interdits.

- Risque élevé : Les systèmes d'IA susceptibles de présenter des risques graves pour la santé, la sécurité ou les droits fondamentaux sont soumis à des règles strictes en matière de transparence, de qualité, d'évaluation des risques et de documentation.

- Risque limité : Les systèmes d'IA qui ne sont pas considérés comme dangereux, mais qui nécessitent tout de même un niveau minimum de transparence pour protéger les utilisateurs et instaurer la confiance.

- Obligations de divulgation : Si une personne interagit avec un système d'IA, comme un chatbot ou un assistant virtuel, elle doit être clairement informée qu'elle parle à une machine. Cela permet aux utilisateurs de prendre des décisions éclairées et d'éviter d'être induits en erreur.

- Contenu généré par l'IA : Si une IA crée du contenu (texte, image, vidéo), le fournisseur doit s'assurer que ce contenu est reconnaissable comme étant généré par l'IA.

- Risque minime ou nul : non inclus dans la loi sur l'IA.

https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

Principales étapes du AI Act

La loi sur loi européenne sur l’IA prévoit un déploiement progressif pour donner aux entreprises le temps de s'adapter, mais avec des échéances rigides. Ces derniers mois, plusieurs grandes entreprises technologiques et même certains États membres de l'UE ont demandé une pause dans la mise en œuvre de la législation, invoquant le manque de clarté et la lourdeur de la mise en conformité.

Toutefois, la Commission européenne a fermement rejeté ces demandes. Au début de juillet 2025, elle a confirmé que la loi AI serait appliquée exactement comme prévu, soulignant ainsi l'engagement de l'UE en faveur d'un développement de l'IA responsable et digne de confiance.

Phase 1 : Février 2025 - Interdiction de l'IA impliquant un risque inacceptable

Cette phase introduit une interdiction des systèmes d'IA qui présentent un risque inacceptable pour les droits fondamentaux et la sécurité. Il s'agit notamment des systèmes suivants:

- Les systèmes de notation sociale (par exemple, le classement des citoyens en fonction de leur comportement ou de leurs traits de caractère).

- La surveillance biométrique en temps réel dans les espaces publics (sauf dans des conditions strictes d'application de la loi).

- L'IA manipulatrice ou exploitante, comme les systèmes qui ciblent les populations vulnérables.

Ces applications sont considérées comme incompatibles avec les valeurs de l'UE et sont strictement interdites.

Phase 2 : Août 2025 - Obligations de transparence pour les systèmes GPAI

Un tournant crucial pour les prestataires de modèles d'IA à usage général (General Purpose Artificial Intelligence - GPAI) tels que les grands modèles de langage et les générateurs d'images.

À partir de cette date, les prestataires devront :

- Indiquer clairement le contenu généré par l'IA, en particulier les deepfakes ou les médias synthétiques destinés à la communication publique.

- Dévoiler les résumés des données d'entraînement, y compris tout contenu protégé par des droits d'auteur.

- Effectuer régulièrement des tests de biais et de toxicité afin d'atténuer les résultats nuisibles.

- Mettre en œuvre des garanties de robustesse et de cybersécurité.

Cette phase introduit des obligations concrètes en matière de transparence et de responsabilité, en particulier pour les technologies d'IA majeures ayant une grande portée.

Phase 3 : Août 2026 - Systèmes d'IA à haut risque et conformité totale

Il s'agit de la phase finale, qui s'applique aux systèmes d'IA à haut risque dans des secteurs tels que :

- Les ressources humaines et le recrutement,

- L'éducation,

- Les soins de santé,

- L'application de la loi et le contrôle des frontières,

- Les finances.

Les obligations comprennent :

- Réussir les évaluations de conformité avant l'entrée sur le marché,

- Mettre en place des mécanismes de gestion des risques et de surveillance humaine,

- Assurer une traçabilité complète, l'enregistrement des données et la notification des incidents.

Des amendes pouvant aller jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires mondial peuvent être imposées en cas d'infraction, ce qui souligne la nécessité d'une mise en conformité proactive, en particulier pour les entreprises opérant à grande échelle.

🚨 Pourquoi c'est crucial

Les entreprises doivent agir dès maintenant pour s'aligner sur les phases de la loi sur l'IA. Les 12 prochains mois sont cruciaux pour mettre en place la bonne gouvernance, la bonne documentation et les bons cadres techniques, non seulement pour se conformer, mais aussi pour construire une base de confiance, de résilience et d'innovation éthique.

La loi européenne sur l'IA n'est pas seulement un cadre juridique : c'est un accélérateur de la transformation des entreprises. Il remodèlera la façon dont les entreprises construisent, déploient et gèrent l'IA, ce qui nécessitera des ajustements majeurs de la part des équipes juridiques, techniques et opérationnelles.

Les entreprises, en particulier celles qui travaillent avec l'IA à usage général (GPAI) ou avec des applications d'IA à haut risque, sont confrontées à un défi de conformité sans précédent. Le Code de Bonnes Pratiques attendu, qui aidera à clarifier la manière de se conformer aux obligations de l'IAGP, est encore en cours d'élaboration et pourrait n'être disponible qu'à la fin de l'année 2025. Cela oblige les entreprises à agir dans l'incertitude, en équilibrant l'innovation et le risque juridique.

-> Les équipes juridiques et de produits doivent collaborer dès maintenant pour anticiper les exigences en matière de documentation, de transparence et de gouvernance avant qu'elles ne soient officiellement détaillée.

Transformer la conformité en opportunité

Chez Eminence, nous ne nous contentons pas de vous aider à vous conformer à l'EU AI Act 2025, mais nous vous aidons à transformer la réglementation en avantage stratégique. Alors que de nombreuses entreprises attendent encore des éclaircissements ou font pression pour obtenir des délais, nous vous donnons les moyens d'agir rapidement, d'instaurer la confiance et de diriger en toute confiance dans un paysage de l'IA réglementé.

Voici comment :

1. Audit de l'état de préparation à l'IA et analyse des risques

Nous commençons par un audit personnalisé de vos systèmes d'IA actuels et prévus pour :

- Identifier ce qui est qualifié de GPAI, de risque élevé ou de risque limité en vertu de la loi sur l'IA.

- Examiner et évaluer les pratiques en matière de données, les résultats des modèles et les obligations de transparence.

- Fournir une carte de classification des risques claire et un calendrier basé sur votre secteur et vos cas d'utilisation.

2. Documentation de conformité et cadre de gouvernance

Nous vous aidons à élaborer toute la documentation interne requise, sans ralentir vos activités :

- Résumés des données de formation et rapports sur les droits d'auteur pour le GPAI.

- Protocoles de tests de biais, de toxicité et de robustesse.

- Procédures de surveillance humaine et modèles de suivi des incidents.

- Alignement sur les prochaines recommandations du Code de Bonnes Pratiques.

3. Mise en œuvre du processus de conformité de l'IA

Pour les systèmes à haut risque et les fournisseurs de GPAI, nous prenons en charge le cycle de vie complet de la gouvernance de l'IA :

- Support technique pour les évaluations de conformité.

- Intégration du flux de travail : étapes d'évaluation des risques intégrées dans votre cycle de vie de développement ou de produit.

- Collaboration avec vos équipes juridiques et informatiques pour mettre en œuvre des pratiques de conception, de contrôle et de test conformes à l'UE.

4. Stratégie commerciale et positionnement sur le marché

La préparation réglementaire n'est pas seulement un coût supplémentaire : c'est un avantage concurrentiel.

Nous vous aidons à:

- Utiliser la transparence, l'équité et l'explicabilité comme signaux de confiance dans votre marketing et vos ventes.

- Équiper vos équipes pour répondre aux appels d'offres ou aux contrôles d'approvisionnement qui exigent désormais une preuve de conformité à l'IA.

- Aligner votre stratégie en matière d'IA et de données sur les valeurs européennes, ce qui fait de vous un acteur de confiance dans les appels d'offres publics et privés.

5. Surveillance continue et pérennisation

La réglementation évolue, tout comme les modèles d'IA. Eminence s'assure que vous êtes prêt non seulement pour 2025, mais aussi pour ce qui suivra :

- Mises à jour régulières et formations sur les changements réglementaires (par exemple, stratégie de consentement, code de pratique, règles spécifiques au secteur).

- Outils de contrôle continu pour suivre le comportement et les performances des modèles d'IA.

- Prévoyance stratégique pour aligner votre feuille de route d'innovation en matière d'IA sur les attentes juridiques et éthiques à venir.

Abonnez-vous à notre newsletter et accédez à des analyses stratégiques, des insights exclusifs et des conseils d'experts pour booster votre présence en ligne.

Conclusion

La phase 2 de l’IA Act démarre en août 2025 avec des obligations obligatoires pour les systèmes GPAI, suivies par des règles supplémentaires sur l'IA à haut risque en août 2026. Les entreprises ne bénéficient d'aucun délai ni d'aucune période de grâce et doivent agir dès maintenant. Transformer la conformité en un atout stratégique implique une gouvernance proactive, la transparence et une différenciation fondée sur la confiance.

Que vous déployiez des outils d'IA orientés clients, que vous travailliez sur l'automatisation interne ou que vous gériez des applications GPAI, Eminence vous offre la stratégie, la structure et le soutien dont vous avez besoin pour vous conformer à la loi sur l'IA sans compromettre l'innovation.

👉 Commencez à vous préparer dès maintenant pour qu'à l'arrivée d'août 2025, vous soyez déjà à l'avant-garde.

![Comment Mettre en Place une Stratégie M Commerce [Marketing Mobile] ?](https://eminence.ch/wp-content/uploads/resizefly/2025/08/Comment-mettre-en-place-une-strategie-marketing-mobile-1-370x144@1.jpg)